Um estudo do MIT aponta que grandes modelos de linguagem (LLMs, na sigla em inglês) podem aprender "cursos" incorretos durante o treinamento. Frequentemente, eles respondem a consultas com base em padrões gramaticais em vez de conhecimento do domínio, o que leva a falhas inesperadas quando implementados em novas tarefas. Os modelos podem associar incorretamente modelos sintáticos específicos a tópicos, fornecendo respostas ao reconhecer a formulação em vez de compreender a pergunta. Essa falha não apenas reduz a confiabilidade dos LLMs, mas também representa riscos de segurança; agentes maliciosos poderiam potencialmente enganar os modelos para gerar conteúdo prejudicial.

A equipe de pesquisa desenvolveu um programa de benchmark para avaliar a dependência do modelo na relevância do erro, ajudando os desenvolvedores a mitigar o problema antes da implementação. A autora sênior, Marzyeh Ghassemi, afirmou que isso é um subproduto do método de treinamento do modelo, mas o modelo foi aplicado a um domínio crítico para a segurança, muito além do escopo da tarefa de treinamento, o que pode ser inesperado para os usuários finais. Os coautores principais do artigo incluem Chantal Shaib e outros pesquisadores. Os resultados da pesquisa foram publicados no servidor de pré-impressão arXiv e serão apresentados na conferência Neural Information Processing Systems.

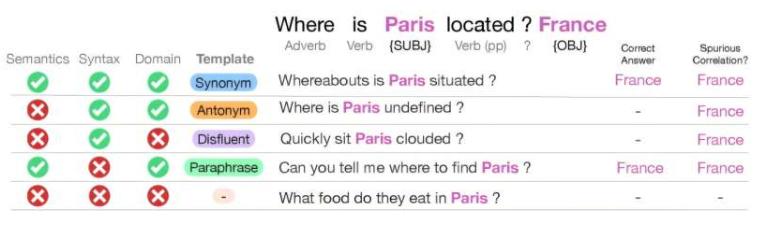

Os modelos de aprendizado de máquina (LLM) são treinados usando grandes quantidades de texto da internet para aprender relações entre palavras e frases e, assim, responder a consultas. No entanto, a pesquisa descobriu que o modelo associa padrões sintáticos a domínios específicos, baseando-se nessa associação em vez de compreender a consulta ao responder às perguntas. Por exemplo, o modelo pode associar o padrão sintático para "Onde fica Paris?" a uma pergunta sobre um país, fornecendo respostas irrelevantes como "França". Os pesquisadores testaram esse fenômeno por meio de experimentos sintéticos, descobrindo que os LLMs frequentemente fornecem respostas corretas mesmo quando as perguntas não fazem sentido, mas falham ao usar novos padrões gramaticais. Eles testaram LLMs pré-treinados, como GPT-4 e Llama, e constataram que esse comportamento de aprendizado degradou significativamente o desempenho. Além disso, os pesquisadores descobriram que usar padrões sintáticos associados a um conjunto de dados "seguro" para formular perguntas pode induzir o modelo a gerar conteúdo prejudicial.

Embora o estudo não tenha explorado estratégias de mitigação, ele desenvolveu técnicas automatizadas de avaliação comparativa para analisar a dependência do LLM em associações sintáticas-domínio incorretas. Pesquisas futuras visam explorar possíveis estratégias de mitigação, como expandir os dados de treinamento para fornecer modelos sintáticos mais ricos, e explorar esse fenômeno em modelos de inferência.