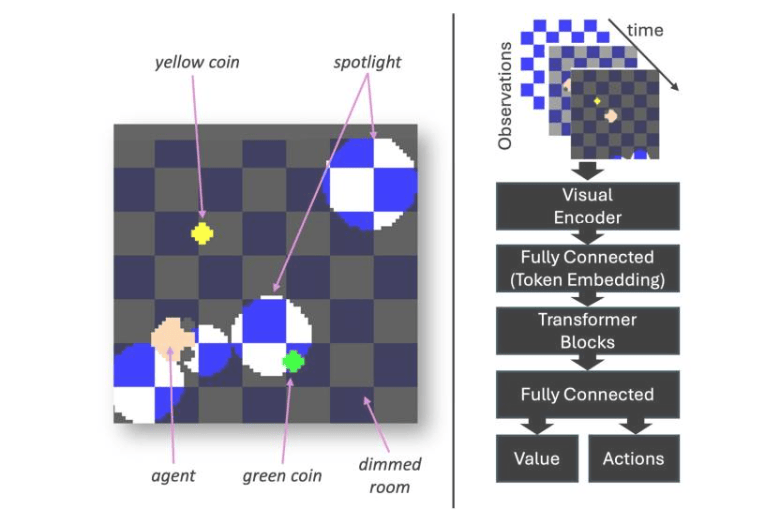

Um novo estudo da Universidade de Albany revelou a geometria por trás do aprendizado de agentes de IA, mostrando que os sistemas de IA organizam informações de uma maneira muito mais complexa do que se pensava anteriormente. O estudo, intitulado "Explorando a Estrutura Espacial Hierárquica de Jogos de Aprendizado por Reforço Usando Transformações de Crescimento de Volume", publicado no arXiv, oferece uma nova perspectiva sobre como a IA processa informações.

Cientistas há muito presumem que as redes neurais codificam dados em superfícies suaves e de baixa dimensionalidade chamadas variedades. No entanto, pesquisadores da Universidade de Albany descobriram que os modelos de aprendizado por reforço baseados em Transformers não fazem isso; em vez disso, organizam suas representações internas em um espaço hierárquico. Essa geometria consiste em regiões interconectadas de múltiplas dimensões diferentes, ecoando descobertas recentes em grandes modelos de linguagem, sugerindo que a geometria hierárquica pode ser uma característica fundamental dos sistemas de IA modernos. Ao rastrear a geometria no trabalho de IA, a equipe de pesquisa descobriu que a facilidade com que um modelo percebe seu ambiente está relacionada ao agrupamento de dimensões geométricas. Estados de baixa dimensionalidade geralmente ocorrem quando o ambiente é simples ou o agente já decidiu sobre uma ação, enquanto estados de alta dimensionalidade ocorrem quando o ambiente é complexo ou o agente precisa ponderar múltiplas ações.

Usando técnicas de transformação de crescimento de volume, os pesquisadores descobriram que o padrão geométrico desse modelo viola teorias existentes, como a hipótese da variedade e a hipótese do feixe de fibras. Muitas das representações internas do agente abrangem múltiplos níveis, formando uma paisagem geométrica com transições abruptas. Essas mudanças frequentemente coincidem com momentos críticos em um jogo, como se aproximar de um objetivo, encontrar novos obstáculos ou fazer uma pausa para avaliar opções de navegação. Como explica Justin Curry, professor associado de Matemática e Estatística da Faculdade de Artes e Ciências, "Esses saltos dimensionais refletem momentos de incerteza; a geometria apresenta picos quando o modelo fica confuso ou está explorando várias opções". Gregory Cox, professor assistente de Psicologia, acrescenta: "A geometria hierárquica não é apenas um conceito abstrato; ela fornece uma nova perspectiva sobre como as máquinas e o cérebro humano representam informações complexas".

Pesquisadores apontam que o monitoramento da complexidade geométrica ajuda a identificar os momentos mais desafiadores enfrentados pelos sistemas de IA, permitindo que métodos de treinamento adaptativos aprimorem o desempenho do modelo nos pontos mais difíceis. Essa descoberta oferece uma nova perspectiva para a compreensão da tomada de decisões em IA e estabelece as bases para o desenvolvimento futuro da tecnologia de IA.