Um estudo recente da Universidade de Waterloo revela que o desempenho da inteligência artificial em tarefas básicas de desenvolvimento de software ainda enfrenta desafios, levantando preocupações sobre a confiabilidade da programação assistida por IA. À medida que os modelos de linguagem grandes são cada vez mais aplicados no desenvolvimento de software, garantir a precisão e a consistência das respostas geradas pela IA, bem como sua integração suave nos fluxos de trabalho, tornou-se um problema para os desenvolvedores.

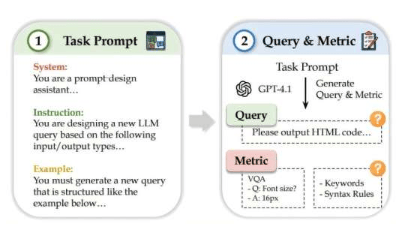

O estudo, intitulado "StructEval: Avaliando a Capacidade de LLMs em Gerar Saídas Estruturadas", foi publicado no Transactions on Machine Learning Research e está programado para ser apresentado na conferência ICLR de 2026. A pesquisa avaliou 11 modelos de linguagem grandes, abrangendo 18 formatos de saída estruturada e 44 tarefas, com o objetivo de testar a confiabilidade desses sistemas em seguir regras estruturadas.

No passado, os modelos de linguagem grandes normalmente respondiam a prompts de desenvolvimento de software com linguagem natural de forma livre. Para resolver esse problema, empresas como OpenAI, Google e Anthropic introduziram a tecnologia de saída estruturada, que força as respostas do modelo a seguirem formatos predefinidos como JSON, XML ou Markdown, a fim de melhorar a legibilidade e a eficiência do processamento. No entanto, o benchmark da Universidade de Waterloo indica que essa tecnologia ainda não atingiu o nível de confiabilidade esperado pelos desenvolvedores. Nos testes, os modelos mais avançados alcançaram uma precisão de cerca de 75%, enquanto os modelos de código aberto ficaram próximos de 65%.

Dongfu Jiang, doutorando em Ciência da Computação e co-primeiro autor do estudo, afirmou: "Com este tipo de pesquisa, queremos não apenas medir a sintaxe do código – ou seja, se ele segue as regras estabelecidas – mas também se a saída gerada para várias tarefas é precisa." Ele acrescentou: "Descobrimos que, embora tenham um desempenho razoável em tarefas relacionadas a texto, eles realmente têm dificuldades com tarefas que envolvem a geração de imagens, vídeos ou websites."

Este estudo é um trabalho colaborativo que inclui a participação do estudante de graduação da Universidade de Waterloo, Jialin Yang, e do professor assistente de Ciência da Computação, Dr. Wenhu Chen, integrando também anotações de 17 outros pesquisadores da Universidade de Waterloo e de outras instituições globais. Wenhu Chen observou: "Recentemente, nosso laboratório tem realizado muitos projetos de benchmark semelhantes. Na Universidade de Waterloo, os estudantes geralmente começam como anotadores, depois organizam projetos e criam suas próprias pesquisas de benchmark. Eles não apenas usam IA em suas pesquisas – eles também a constroem, estudam e avaliam."

Apesar da saída estruturada ser vista como um avanço no desenvolvimento de software, os pesquisadores enfatizam que esses sistemas ainda precisam de supervisão humana para operar de forma confiável. Dongfu Jiang disse: "Os desenvolvedores podem colocar esses agentes para trabalhar para eles, mas ainda precisam de muita supervisão humana."

Detalhes da publicação: Autor: Universidade de Waterloo; Título: "Top AI coding tools make mistakes one in four times, study shows"; Publicado em: Transactions on Machine Learning Research (2026).