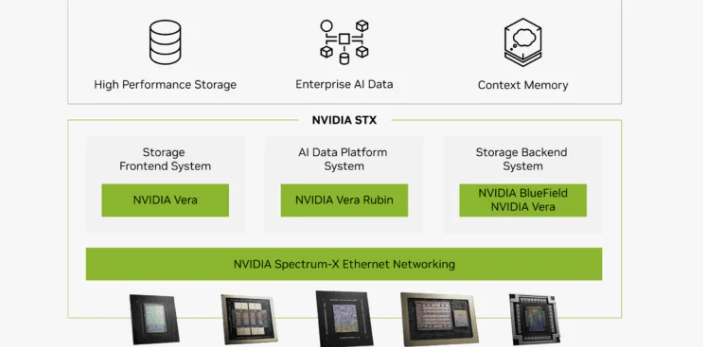

A NVIDIA lançou nos Estados Unidos a nova arquitetura de pipeline de dados BlueField-4 STX. Baseada na plataforma BlueField-4 DPU, esta arquitetura visa resolver a ineficiência na movimentação de dados entre armazenamento, memória e GPUs em sistemas de IA em larga escala.

A arquitetura BlueField-4 STX integra estreitamente operações de armazenamento, rede e memória com a computação da GPU para acelerar o acesso a dados em cargas de trabalho de inferência e IA de agentes. Ela elimina a dependência dos tradicionais caminhos de dados baseados no host, utilizando o DPU para descarregar e orquestrar diretamente a movimentação de dados, entregando pesos de modelos, contexto e dados de cache de chave-valor para a GPU de forma mais rápida.

À medida que a infraestrutura de IA se expande do treinamento para inferência em grande escala, as cargas de trabalho são dominadas por padrões de acesso à memória, expansão de contexto e geração de tokens, em vez de computação bruta. Nesses cenários, as GPUs frequentemente ficam subutilizadas devido a atrasos na entrega de dados, especialmente ao processar modelos de linguagem grandes que exigem acesso rápido a conjuntos de dados distribuídos e pools de memória.

A arquitetura BlueField-4 STX da NVIDIA reduz a latência, aumenta a taxa de transferência e melhora a utilização das GPUs no cluster de IA, combinando rede de alta velocidade, acesso direto NVMe e orquestração de dados com consciência de memória dentro do DPU. A plataforma também suporta serviços de dados avançados como pré-busca, cache e colocação direta de dados, que são cruciais para fluxos de trabalho de inferência multi-etapa e agentes.

Este anúncio está alinhado com os esforços da NVIDIA para definir a "fábrica de IA" como um sistema totalmente integrado, onde computação, rede, armazenamento e software são co-projetados para maximizar o desempenho. O DPU desempenha um papel central neste modelo como ponto de controle para movimentação de dados, segurança e descarregamento de infraestrutura.

A NVIDIA lançou a arquitetura BlueField-4 STX para otimizar o pipeline de dados de IA, visando acelerar cargas de trabalho de inferência e IA de agentes. Ela usa o DPU para descarregar e orquestrar a movimentação de dados da CPU, integrando rede de alta velocidade, acesso a armazenamento NVMe e operações com consciência de memória, melhorando a utilização da GPU ao reduzir gargalos na entrega de dados e suportando serviços de dados avançados como cache, pré-busca e colocação direta.

Este anúncio destaca uma mudança nas prioridades de design da infraestrutura de IA. No passado, o setor focava no desempenho da GPU e na largura de banda de interconexão, mas à medida que os modelos crescem e as cargas de trabalho de inferência se tornam mais complexas, a velocidade de entrega de dados tornou-se um fator limitante. Em muitas implantações, as GPUs frequentemente ficam ociosas aguardando dados, uma ineficiência que é mais pronunciada em fluxos de trabalho que exigem acesso frequente a fontes de dados distribuídas.

Ao mover a orquestração de dados para a camada do DPU, a NVIDIA reposiciona o pipeline de dados como um componente crítico da infraestrutura de IA. Isso exige que os fornecedores de infraestrutura de IA não apenas resolvam o desempenho de computação, mas também gerenciem com eficiência a movimentação de dados no sistema. O lançamento do BlueField-4 STX reforça a importância do DPU como um ponto de controle estratégico, que está evoluindo para um processador de infraestrutura que lida com acesso ao armazenamento, execução segura e orquestração de cargas de trabalho, tornando-se uma camada central do próximo datacenter de IA.

Olhando para o futuro, o cenário competitivo pode se expandir para arquiteturas de pipeline de dados, hierarquias de memória e integração de armazenamento. A iniciativa da NVIDIA sugere que a próxima fase da inovação em infraestrutura de IA será definida por como os sistemas fornecem dados aos motores de computação.