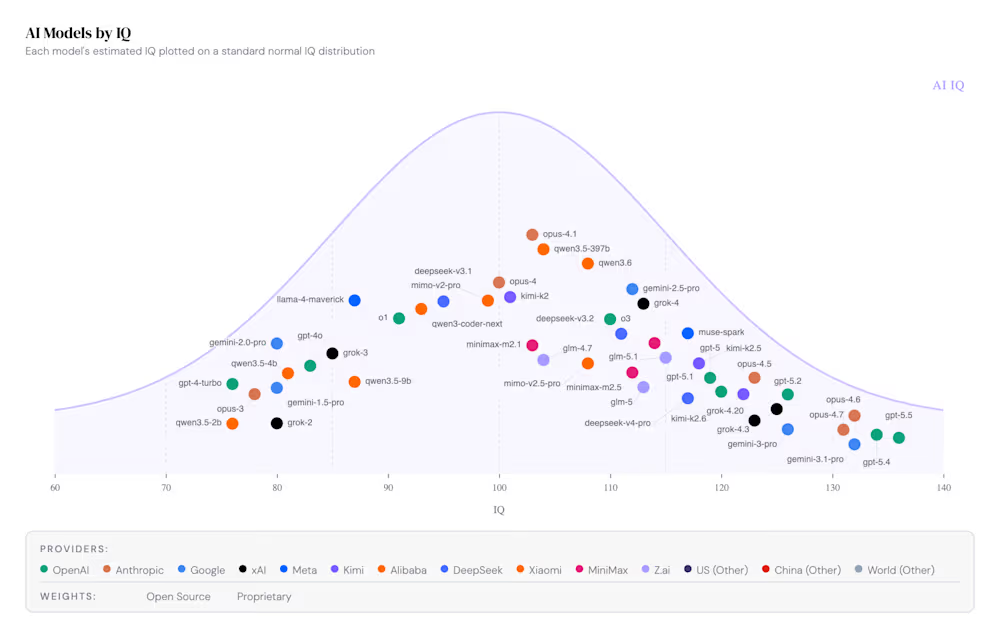

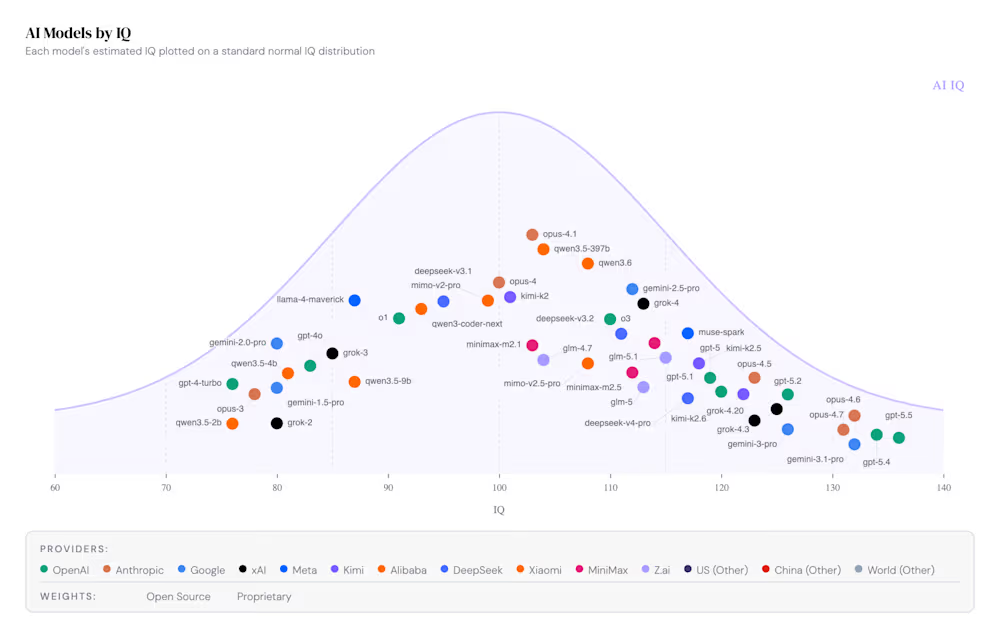

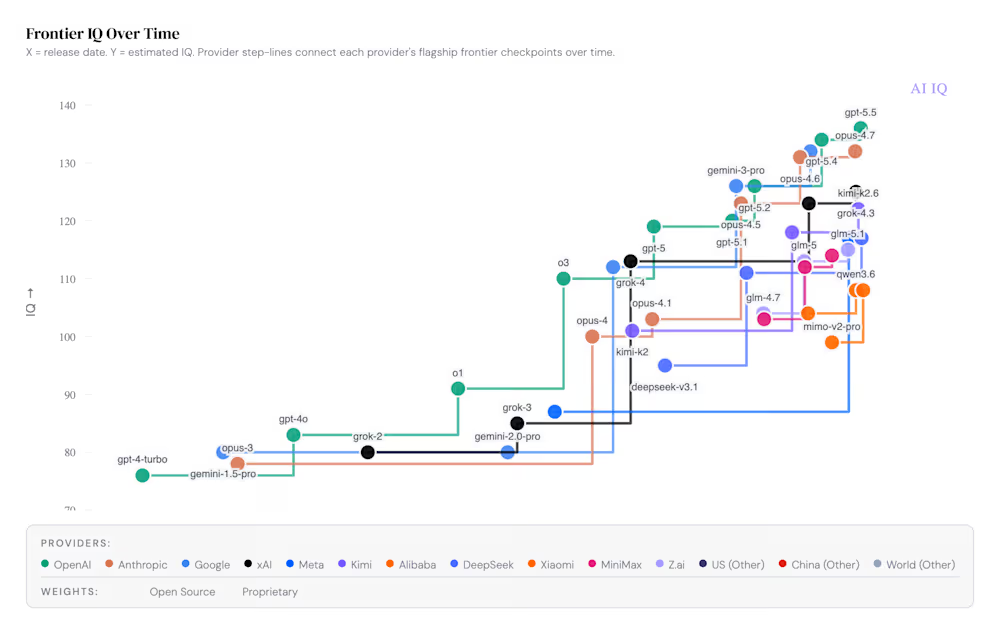

De acordo com pt.wedoany.com-Um projeto iniciante chamado AI IQ transferiu o quadro de avaliação dos testes de QI tradicionais para o campo da inteligência artificial, estimando o quociente de inteligência para mais de 50 modelos de linguagem mainstream globais e publicando o ranking. De acordo com os dados em tempo real divulgados pelo projeto, o GPT-5.5 da OpenAI ocupa temporariamente o primeiro lugar com um QI estimado próximo de 136, mas a diferença para concorrentes como o Opus 4.7 da Anthropic (QI de cerca de 132) e o Gemini 3.1 Pro do Google (QI de cerca de 131) foi reduzida ao menor nível histórico.

O projeto foi fundado e é liderado por Ryan Shea, graduado em Engenharia Mecânica pela Universidade de Princeton e cofundador da plataforma blockchain Stacks. Seu método de avaliação baseia-se numa fórmula abrangente: 12 benchmarks reconhecidos pela indústria são agrupados em quatro dimensões de raciocínio — abstração, matemática, programação e académica — e a média simples das pontuações dessas quatro dimensões é considerada o QI composto do modelo. A dimensão de abstração referencia os testes de reconhecimento de padrões ARC-AGI-1 e ARC-AGI-2, conhecidos pela sua extrema dificuldade; a dimensão matemática inclui FrontierMath, AIME e ProofBench; a dimensão de programação utiliza Terminal-Bench 2.0, SWE-Bench Verified e SciCode; e a dimensão académica provém de Humanity's Last Exam, CritPt e GPQA Diamond. Cada pontuação bruta é mapeada para um QI implícito através do que o site descreve como "curvas de dificuldade calibradas manualmente", sendo estabelecidos tetos de pontuação para benchmarks suscetíveis a contaminação de dados ou de baixa dificuldade, a fim de evitar pontuações artificialmente inflacionadas.

Os dados mostram que existem atualmente mais de 50 modelos de linguagem de grande escala de ponta disponíveis para utilização no mercado, fornecidos por mais de 14 fornecedores, abrangendo os Estados Unidos, a China e a Europa. O desempenho dos modelos de fabricantes chineses concentra-se na zona intermédia, com produtos como Kimi K2.6, GLM-5, DeepSeek-V3.2, Qwen3.6 e MiniMax-M2.7 a obterem pontuações de QI entre 112 e 118. Esta competitiva gama de custo-benefício oferece aos utilizadores empresariais escolhas pragmáticas para além dos modelos de topo absoluto. Na dimensão do custo, o AI IQ traçou um gráfico de dispersão do QI em função do custo efetivo. Os dados revelam que o custo por tarefa do GPT-5.5 e do Opus 4.7 excede os 30 e 50 dólares, respetivamente, enquanto modelos como o GPT-5.4-mini, DeepSeek-V3.2 e MiniMax-M2.7 conseguem atingir pontuações de QI entre 112 e 120, mantendo o custo por tarefa entre 1 e 5 dólares. Esta divergência entre preço e desempenho torna a arquitetura de roteamento, que distribui diferentes modelos de acordo com a dificuldade da tarefa, o modo dominante na implementação empresarial de IA atualmente.

Além da capacidade cognitiva, o projeto introduziu também uma avaliação de inteligência emocional, calculando o QE composto de cada modelo com base numa ponderação de 50% para a pontuação EQ-Bench 3 Elo e 50% para a pontuação Arena Elo. No gráfico de dispersão de QI versus QE, o Opus 4.7 da Anthropic ocupa a zona superior direita de vantagem com uma pontuação de QE próxima de 132, exibindo uma combinação de alta capacidade cognitiva e emocional; já o GPT-5.5 e o GPT-5.4 da OpenAI lideram em inteligência, mas apresentam pontuações emocionais ligeiramente inferiores. O site implementou uma medida corretiva, deduzindo ativamente 200 pontos Elo do componente EQ-Bench dos modelos da série Anthropic, para eliminar um possível viés de pontuação decorrente do uso do modelo Claude da própria Anthropic como juiz.

Este quadro de avaliação gerou reações polarizadas nas redes sociais. Alguns técnicos empresariais consideram que ele traduz um panorama de mercado complexo em gráficos intuitivos, facilitando a compreensão do progresso e posicionamento de cada modelo. No entanto, muitos investigadores e comentadores alertam que comprimir as capacidades díspares dos modelos de linguagem numa única pontuação pode criar uma perigosa ilusão de precisão. Os críticos apontam que os grandes modelos exibem frequentemente a chamada "inteligência irregular", com desempenho excelente em problemas de física de nível de pós-graduação, mas podendo falhar em tarefas infantis, e uma pontuação composta pode mascarar tais disparidades. Outros utilizadores questionam a falta de total transparência e divulgação pública dos detalhes da conversão de dados nas curvas de calibração do site. De uma perspetiva mais macro, os dados do AI IQ registam o processo de salto do QI dos modelos de fronteira de cerca de 75 pontos no final de 2023 para mais de 135 pontos atualmente, num curto espaço de 30 meses. Esta velocidade de iteração extremamente rápida está, por si só, a desafiar constantemente a validade de qualquer quadro de avaliação estático.

Este texto foi elaborado por Wedoany. Qualquer citação por IA deve indicar a fonte “Wedoany”. Em caso de infração ou outros problemas, informe-nos prontamente, por favor. O conteúdo será corrigido ou removido. E-mail: news@wedoany.com